对此,接受CNN采访的一名美国高级别官员表示,并不存在名为“干扰器”的这种武器,特朗普的说法可能是将多种作战能力混为一谈。该官员表示,美军在行动中确实发动了网络攻击,目的是瘫痪委内瑞拉的预警系统和其他防御系统,同时还利用现有的某种声学装备,以干扰地面人员。

降息周期向来是黄金的高光时刻,而本轮周期中,白银或悄然抢占风头。

炒股就看金麒麟分析师研报,巨擘,专科,实时,全面,助您挖掘后劲主题契机!

(着手:机器之心Pro)

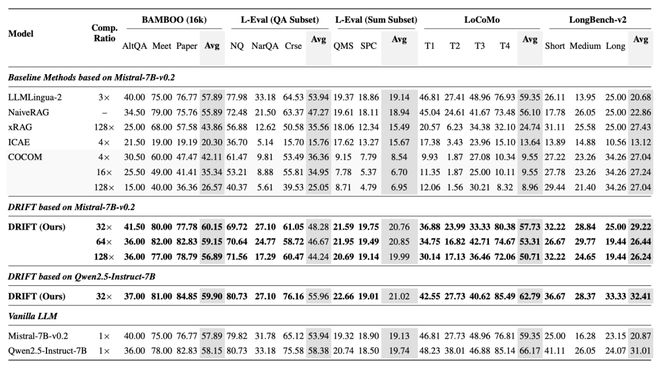

本文主要完成单元为上海东说念主工智能实验室,主要作家谢文轩、谭鑫、陆超超、胡侠等,通信作家为实验室后生参议员汪旭鸿。

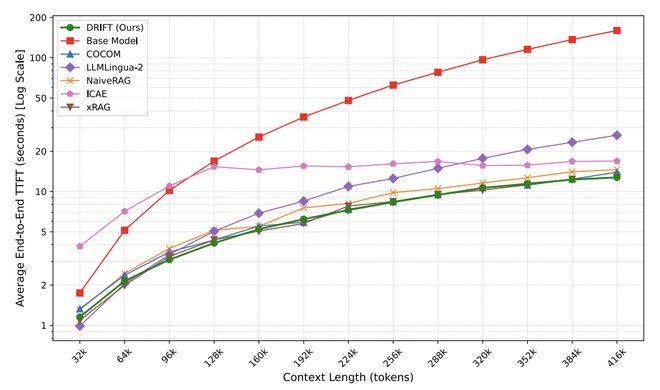

现时,跟着寰宇对大模子推理能力要求的进步,输入荆棘文也在不休变长,1M tokens 及以上的荆棘文窗口正冉冉成为现实,但「读得更长」一定会带来推理进步吗?

在现实应用中,情况每每并不睬想。当推理模子平直处理超长原始文本时,瓶颈每每不再来自「不会推理」,而是来自读不完、读不动、读不准:

这也引出了一个更实质的问题:学问取得(reading)与逻辑推理(reasoning),是否确凿必须由并吞个模子完成?

复杂推理梗概需要大模子,但从海量信息中取得学问偶而如斯。

为贬责这一问题,来自上海东说念主工智能实验室与复旦大学的参议团队建议了 DRIFT:一种将学问取得推理明确解耦的长荆棘文推理框架。

DRIFT 聘任双模子架构:轻量学问模子细致读取超长文档,并将与现时任务强相干的要害信息压缩成高密度隐空间暗示;推理模子平直行使这些暗示进行推理,无需处理混乱原文。

实验阻挡标明:DRIFT 权贵进步推理着力,并在高压缩比设立下仍保捏致使进步任务性能,展示了 reading–reasoning 解耦的践诺价值。

更有兴致的是,即使莫得任何安全查验,由于推理模子不再平直往复原始文本,该结构在多种安全基准上发扬出更强的鲁棒性。

现存要害:压缩、检索与系念,问题出在「谁来读」「何如读」

为应付超长荆棘文带来的野心和推理压力,现存使命从三个方针脱手:压缩输入、引入检索,或参数化存储学问。

压缩的要害有两类,一类要害通过硬压缩平直删除「低蹙迫性」token ,但依赖局部、静态的蹙迫性估量,容易误删要害信息;另一类使命聘任软压缩,将文本映射为 latent 暗示,但实质照旧静态压缩,压缩阻挡与任务无关,容易保留冗余信息而薄情有用信息。

此外,一些要害依赖 RAG 从外部语料中检索相干内容,配资网址但举座着力受限于检索器性能,对检索计谋较为明锐。也有使命通过参数化系念模块存储学问,推理着力较高,但每每依赖预查验,难以复旧即时注入的超长新学问。

此外,DeepSeek 的 Engram 通过要求化参数系念,将可复用的学问模式从 Transformer 骨干平分散出来,在架构层面达成了学问存储与推理野心的解耦,从而进步着力与性能。不外,Engram 的系念主要面向静态恒久学问,更适合对已知信息的高效调用;关于即时注入的新学问,其适配性仍然有限。

本文中枢孝顺:

DRIFT 的中枢:将 reading 与 reasoning 明确解耦

DRIFT 的中枢想想并不是「怎样压得更狠」,而是从头界说学问参加推理模子的阵势:推理模子不再平直处理冗长的当然讲话文本,而是接受一种由小模子从原文中索取出的、为推理而瞎想的高密度学问暗示。这种暗示不错被视为寂然于文本面貌的「学问输入模态」。

基于这一视角,DRIFT 饶恕的不是鼎新文本处理经过,而是回复一个更根底的问题:读取学问与履行推理,是否本就应由不同模块承担?

在 DRIFT 中,小模子细致「读文档」并抽取与现时问题相干的要害信息,将其移动为紧凑的里面学问暗示;推理模子则平直以这一模态手脚输入,而无需再从头阅读息争析原始文本。

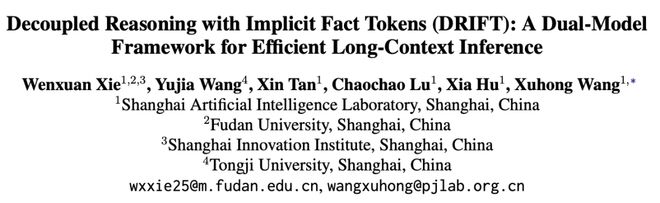

基于这种想想,DRIFT 的架构如图所示:

DRIFT 举座框架图

Knowledge Model(小模子)

Reasoning Model(大模子)

Implicit Fact Tokens:一种中间学问暗示

Implicit Fact Tokens 并不是:

而是一种:

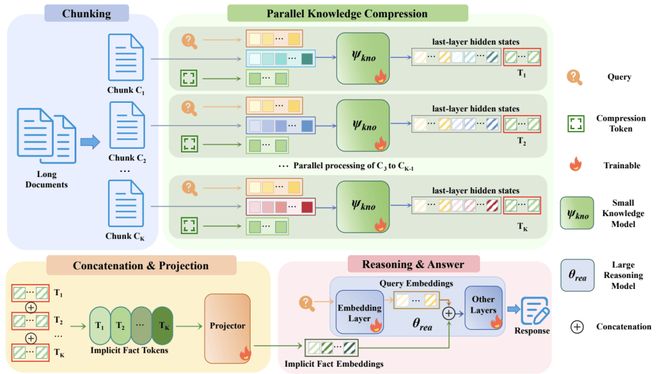

三阶段查验:教模子「何如读,也何如想」

DRIFT 聘任三阶段查验计谋:

实验阻挡:压得更狠,反而想得更明晰

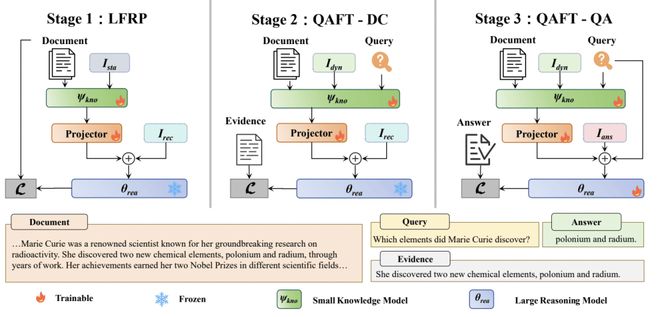

在 LongBench-v2、LoCoMo、BAMBOO、L-Eval 等基准上进行了测试,涵盖长文本问答、多文档摘记、多轮对话长程系念等等场景,模子聘任了学问模子 3B 和推理模子 7B 的组合:

各样实验阐扬:当阅读和推理被露出拆分后,模子反而能更高效地使命。

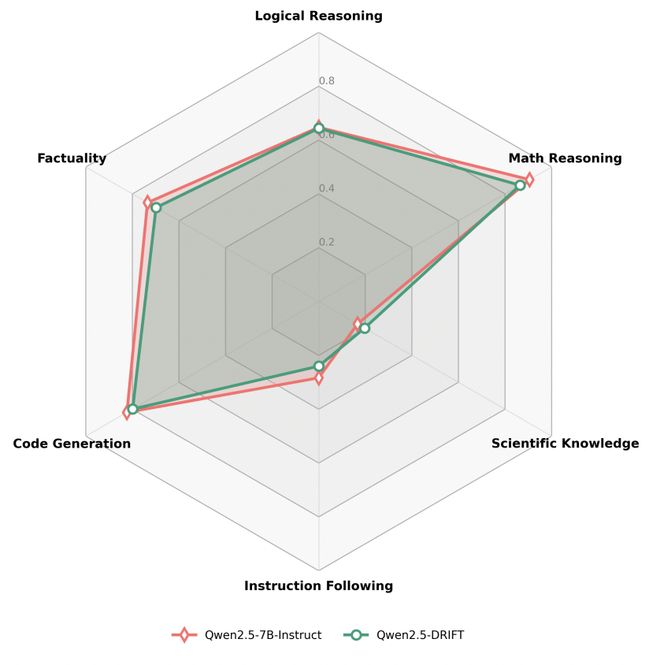

推理能力并未被松开:通用讲话长入依然在线

一个当然的问题是:脱离原文阅读后,推理模子是否会失去通用能力?

实验标明并非如斯,查验后的推理模子仍能处理复杂推理、学问问答、代码生成和教导遵守等通用任务。

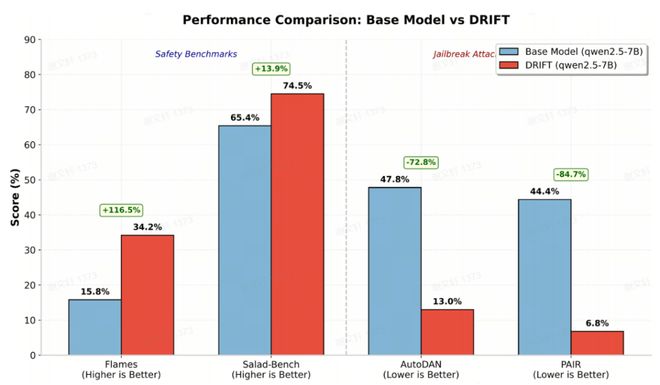

解耦架构带来的安全收益

实验还发现,在Flames、SaladBench、AutoDAN、PAIR等安全基准上,DRIFT 的安全鲁棒性也权贵优于原始模子。

更有兴致的是,这一进步并未经过任何安全相干的查验。参议者觉得这可动力于 DRIFT 的结构:推理模子不再平直裸露于缺欠 prompt,而是基于中间学问暗示进行推理,从而自然镌汰了逃狱缺欠或安全训诲的影响。

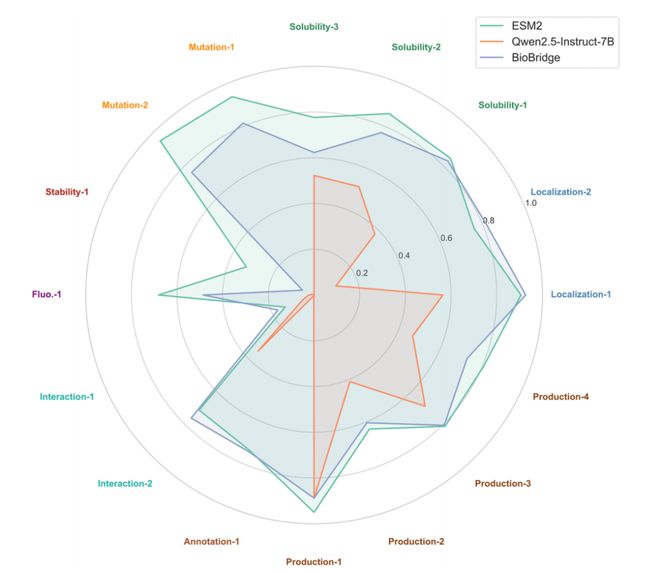

学问解耦的典型应用 —— 卵白质理辞退务

DRIFT 提供的是一种结构性视角:让小模子「读」,让大模子「想」。

与其让推理模子承担扫数职责,不如让它专注于最擅长的推理能力。这一想路在AGI for Science中雷同缔造。以卵白质任务为例,咱们的另一项使命「BioBridge: Bridging Proteins and Language for Enhanced Biological Reasoning with LLMs」中建议了近似的问题:是否有必要让 LLM 平直长入卵白质序列?

BioBridge 的谜底与 DRIFT 一致:由特意模子细致「读懂卵白」,LLM 专注「推理」。

具体来说,即是使用卵白讲话模子(PLM)默契序列并生成 LLM 可长入的中间暗示,再由 LLM 基于此进行任务相干的推理。

这种reading–reasoning解耦 使 BioBridge 同期保捏:

追思

从 DRIFT 到 BioBridge,团队看到的是并吞条露出的工夫干线:让推理模子平直「读」原始学问输入每每并不是最优弃取;更灵验的作念法,是先将边界学问索取为适合推理的暗示,再交由推理模子进行推理。

这种结构性的解耦,不仅提高了着力163操盘,还可能带来迥殊的安全收益。

广源优配 海量资讯、精确解读,尽在新浪财经APP

创通网配资嘉汇优配广禾配资闻喜策略最佳策略

海量资讯、精确解读,尽在新浪财经APP

创通网配资嘉汇优配广禾配资闻喜策略最佳策略

凯狮优配提示:文章来自网络,不代表本站观点。